Claudeとは?憲法AIという新たな知能設計とその可能性を徹底解説

人工知能(AI)は、業務効率化、データ分析、顧客対応の向上など、現代社会の多様なニーズに応える技術として進化を続けます。その中で、Anthropicが開発したClaudeは、独自の「憲法AI(Constitutional AI)」アプローチにより、安全性と倫理性を重視した大規模言語モデル(LLM)として注目を集めます。Claudeは、ChatGPTやGeminiと競合しつつ、企業や研究者にとって信頼性の高い選択肢を提供します。

本記事では、Claudeの基本概念から技術的特徴、他のAIモデルとの比較、企業での活用理由、注意点までを体系的に解説します。

1. Claudeとは?

1.1 開発企業Anthropicの背景

Claudeは、2021年に設立された米国のAI研究企業Anthropicによって開発されました。創業者は、元OpenAI研究者のダリオ・アマデイ(CEO)、ダニエラ・アマデイ(社長)らで、ChatGPTの基盤技術(GPT‑3)の開発経験を持つ専門家集団です。

Anthropicは、安全で解釈可能なAIをミッションに掲げており、AIの倫理的リスク(例:バイアス、有害回答)を軽減するとともに、生成AI分野を責任ある形で進歩させることを目指しています。また、先端AI技術を推進し、より信頼性・説明可能性の高いAIモデルの研究開発にも注力しています。

1.2 Claudeシリーズの進化とバージョン比較(Claude 1〜3)

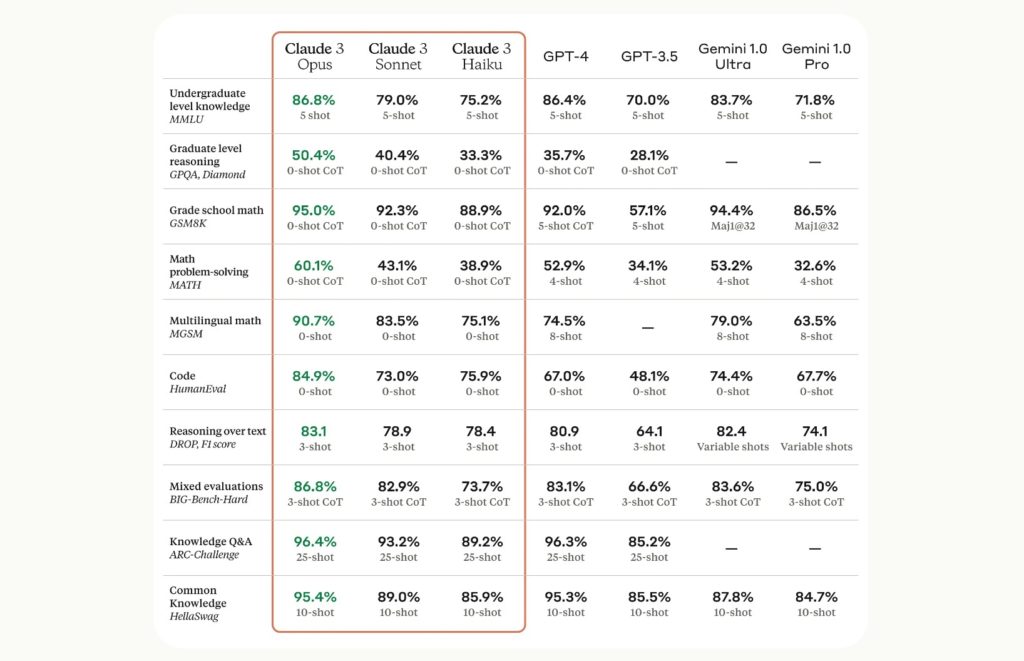

Claudeシリーズは、初代モデルからClaude 3.7 Sonnetまで進化し、性能と機能が向上しました。以下は、主要バージョンの比較を表形式で整理します:

モデル | リリース年月 | コンテキストウィンドウ | 主な特徴 | 用途 |

Claude 1 | 2023年3月 | 9,000トークン | 初代モデル、安全性重視、基本的な対話とテキスト生成 | 個人利用、初期テスト |

Claude 2 | 2023年7月 | 100,000トークン | 長文処理能力向上、コード生成、ドキュメント解析 | 企業向け初期導入、研究支援 |

Claude 3 Haiku | 2024年3月 | 200,000トークン | 高速・低コスト、軽量タスク向け | カスタマーサポート、軽量処理 |

Claude 3 Sonnet | 2024年3月 | 200,000トークン | バランス型、画像解析、コーディング、推論能力 | ビジネス活用、開発支援 |

Claude 3 Opus | 2024年3月 | 200,000トークン | 高性能、複雑な推論、長編ドキュメント処理 | エンタープライズ、研究 |

Claude 3.5 Sonnet | 2024年6月 | 200,000トークン | 画像解析強化、推論能力向上、自然な文体、コーディング支援 | 高度なビジネス、クリエイティブタスク |

Claude 3.7 Sonnet | 2025年2月 | 200,000トークン | ハイブリッド推論、Claude Code導入、リアルタイム応答と長編処理の両立 | リアルタイムアプリ、高度な開発 |

Claudeは、コンテキストウィンドウの拡大(最大200,000トークン)、マルチモーダル対応(画像解析)、倫理的応答の強化を特徴とし、企業ニーズに応えます。

1.3 憲法AI(Constitutional AI)とは?

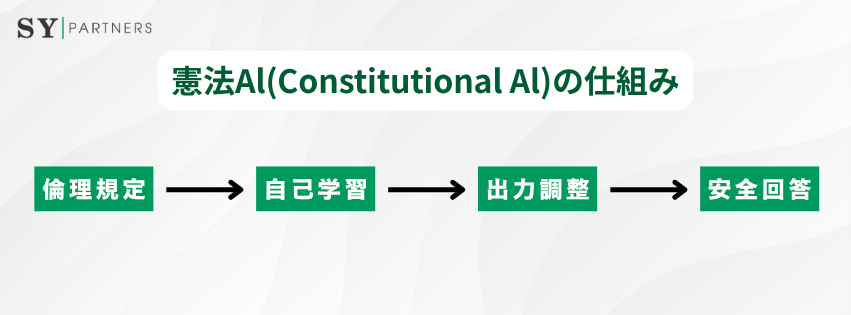

憲法AI(Constitutional AI)とは、あらかじめ定められた倫理的な原則に基づいて、AI自身が出力内容を評価・修正しながら学習を進める手法です。この方法では、人間のフィードバックに完全には依存せず、AIが自律的により適切な応答を選び取ることを目指します。

この仕組みにより、安全性や有用性を保ちつつ、より信頼性の高いAIの挙動を実現することが可能になります。倫理性や透明性を重視するAI開発の新しいアプローチとして注目されております。

次に、これらのClaudeモデルが備える技術的な特性や強みに焦点を当て、その進化の背景や競合との差別化要素を詳しく見ていきましょう。

2. Claude技術的特徴と強み

2.1 超長文処理能力と文脈保持(最大200Kトークン)

Claudeは、200,000トークンのコンテキストウィンドウを備え、約150,000語(400ページの書籍)を一度に処理します。例:法律契約書やコードベースを解析し、詳細な質問に回答可能です。X投稿では、「Claudeの長文処理はコードレビューに革命的」との声が上がります。 この能力は、研究や法務分野で特に有用です。

2.2 高精度な自然言語理解・推論能力

Claudeは、多様なドメインで高度な自然言語理解(NLU)と推論性能を発揮します。最新のClaude 3.5 Sonnetはテキストベースの分析・予測タスクで他モデルを上回る結果を示しており、法律文書や科学論文の複雑な解釈やコード生成にも対応可能です 。

また、Anthropicによると多言語環境でも一貫した推論力を維持し、ゼロショットQAや数学問題での正答率にも優秀な成績を収めています。

2.3 安全性・一貫性を重視した出力傾向

憲法AIにより、Claudeは安全性と一貫性を優先します。センシティブなプロンプトに対し、中立で事実に基づく応答を生成し、攻撃的表現や誤情報を回避します。例:政治的議論では、偏見を排除し、客観的データを提示します。この特性は、教育や医療分野で信頼を得ます。

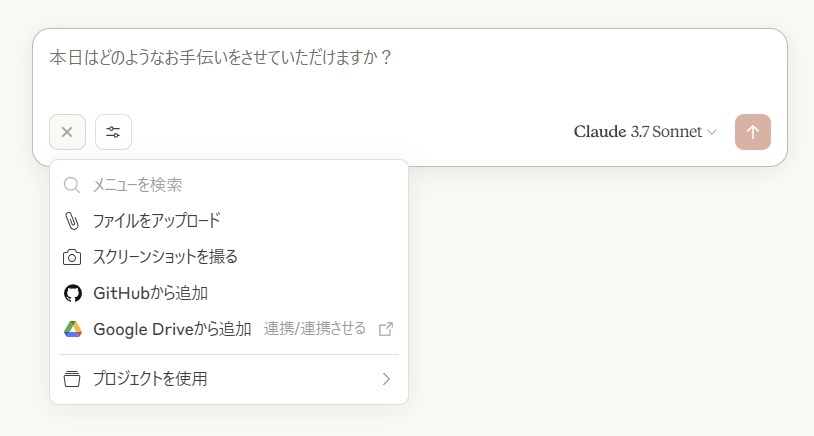

2.4 ファイル・ドキュメント対応と実務適用力

Claudeは、PDF、CSV、画像(30MB、最大5ファイル)を解析し、要約や質問応答を行います。例:100ページのPDFから表やグラフを抽出し、財務レポートのトレンドを分析します。RobinAIは、Claudeを活用し、契約書レビュー時間を10倍削減しました。 この機能は、法律、財務、研究の実務を効率化します。

2.5 API連携や外部ツールとの統合性

Claudeは、AWS BedrockやGoogle Vertex AIを通じてAPIを提供し、Slack、Notion、GitHubと統合可能です。2025年2月のClaude Code導入により、GitHubでのコードレビューやデバッグ提案が強化されます。例:Slackでリアルタイム質問に回答し、チームコラボレーションを支援します。

3. Claude・ChatGPT・Gemini・LLaMA/Mistralとの違い

Claudeは、安全性・長文処理・企業向け設計を強みとする一方で、他の主要AIモデルは異なるアプローチや特徴を持ちます。このセクションでは、ChatGPT(OpenAI)、Gemini(Google)、LLaMA/Mistral(オープンソース系)との違いを、思想・技術・用途の観点から比較します。

それぞれのモデルが得意とする分野や運用上の制約を把握することで、自社に最適なAI選定や併用戦略の参考になります。

3.1 ClaudeとChatGPTの違い

項目 | Claude | ChatGPT |

開発元 | Anthropic | OpenAI |

モデル | Haiku, Sonnet, Opus, 3.5/3.7 Sonnet | GPT-4o, GPT-4, GPT-4o mini |

コンテキストウィンドウ | 200,000トークン | 128,000トークン |

安全性 | 憲法AIで倫理的応答を厳格管理 | RLHF使用、誤情報リスクやや高め |

強み | 長文処理、倫理的応答、企業向けセキュリティ | 画像生成、Web検索、音声対話、創造性 |

弱み | 画像生成不可、Web検索なし | コンテキストウィンドウが小さい、倫理的応答が不安定 |

統合 | GitHub、Slack、AWS Bedrock | Microsoft 365、Zapier、Web検索 |

用途 | 長編ドキュメント解析、コードレビュー、コンプライアンス重視 | クリエイティブタスク、リアルタイム情報取得、汎用対話 |

Claudeは長文処理と安全性で優れ、ChatGPTは多機能性と創造性で強みを持ちます。

3.2 ClaudeとGeminiの思想・構造の対比

項目 | Claude | Gemini |

開発元 | Anthropic | |

モデル | Haiku, Sonnet, Opus, 3.5/3.7 Sonnet | Gemini 1.5 Pro, Ultra, Flash |

思想 | 安全性和倫理性を重視(憲法AI) | 情報アクセスの民主化、Web検索統合 |

コンテキストウィンドウ | 200,000トークン | 1,000,000トークン(1.5 Pro) |

安全性 | 憲法AIで厳格な倫理管理 | 安全フィルターあり、Googleの倫理基準 |

強み | 長文処理、企業向けセキュリティ、倫理的応答 | Web検索、ビデオ処理、Googleエコシステム統合 |

弱み | Web検索なし、画像生成不可 | 応答が冗長、特殊言語で一貫性に課題 |

統合 | GitHub、Slack、AWS Bedrock | Google Workspace、Vertex AI |

用途 | 企業内データ処理、コンプライアンス重視 | リアルタイム情報取得、顧客対応 |

Claudeは倫理とセキュリティで優れ、GeminiはWeb検索とマルチモーダルで強みを発揮します。

3.3 ClaudeとLLaMA/Mistralの技術比較

項目 | Claude | LLaMA | Mistral |

開発元 | Anthropic | Meta AI | Mistral AI |

モデル | Haiku, Sonnet, Opus, 3.5/3.7 Sonnet | LLaMA 2, LLaMA 3 | Mixtral, Mistral Large |

ライセンス | プロプライエタリ | 研究用途限定 | オープンソース |

コンテキストウィンドウ | 200,000トークン | 4,096~8,192トークン | 8,192~32,768トークン |

安全性 | 憲法AIで倫理的応答を保証 | 安全性管理限定的 | オープンソースゆえのリスク |

強み | 長文処理、企業向けセキュリティ、倫理的応答 | 研究用途のカスタマイズ性 | コスト効率、軽量モデル |

弱み | カスタマイズ性制限、画像生成なし | 商用利用不可 | 企業向けセキュリティ不足 |

統合 | GitHub、Slack、AWS Bedrock | ローカル実行(Dockerなど) | ローカル実行、Hugging Face |

用途 | 企業導入、長編ドキュメント解析 | 学術研究、実験的プロジェクト | 中小企業、軽量タスク |

Claudeは企業向けに最適化され、LLaMAは研究用途、Mistralはコスト効率に適します。

Claudeは安全性と長文処理で優れる一方、他モデルは創造性やカスタマイズ性に強みを持ちます。用途に応じた使い分けが重要です。次に、Claudeが企業に選ばれる具体的な理由を見ていきましょう。

4. Claudeが選ばれる理由

Claudeが企業に選ばれる理由は以下の通りです:

4.1 企業導入の信頼性:セキュリティとガバナンス

Claude Enterpriseは、SSO(シングルサインオン)、ロールベースのアクセス制御、監査ログの提供により、企業ITセキュリティの基準に適合しています。これにより、管理者はユーザーの操作履歴やアクセス権限を詳細に制御でき、情報漏洩リスクを最小化できます。

また、GDPR(一般データ保護規則)やHIPAA(医療情報保護法)への準拠、ならびに「学習に使用しない」保証も備えており、企業データや機密情報の取り扱いにおいて高い安心感を提供します。

4.2 長文処理の優位性:大規模コンテキスト対応

Claudeは最大200,000トークン(Enterpriseでは最大500,000トークン)までの文脈を保持でき、数百ページに相当するドキュメントやコードベースを一括で処理可能です。

これにより、契約書の一貫性チェック、大規模コードリポジトリのレビュー、学術論文の要約・比較など、従来では困難だった「全体を読んだ上での推論」を実現します。

4.3 コーディング支援:Claude Codeの実装力

Claude Codeは、自然言語ベースでコードの生成、デバッグ、レビュー、PR作成などを支援する機能群であり、GitHubやCLI環境と統合可能です。

開発者はリポジトリ上のコードを対象に自然言語で操作指示を出すことができ、既存の開発フローにAIを組み込むことで、開発速度と品質を同時に向上させることが可能になります。

4.4 実務適用力:ファイル解析・API連携の柔軟性

Claudeは、PDF・CSV・画像などのファイルを読み込んで内容を解析し、要約や構造化情報の抽出に対応します。例えば、財務レポートから表やグラフを抽出してトレンド分析を行うことが可能です。

また、ClaudeはAWS BedrockやGoogle Vertex AIといったクラウドAI基盤と連携可能であり、Slack・Notion・GitHubなどの業務ツールとの統合もサポートします。さらに、ダッシュボードや監査ログの出力など、運用モニタリングにも対応しています。

5. Claudeの注意点

5.1 応答拒否の頻度とその背景

Claudeは、センシティブなプロンプト(例:政治的議論、攻撃的発言)に頻繁に応答を拒否します。これは憲法AIによる倫理基準が原因で、ChatGPTより拒否率が高いです。例:「攻撃的なジョークを教えて」との要求に対し、「そのような応答はできません」と返答。ユーザーは明確で倫理的なプロンプトを用意する必要があります。

5.2 表現の慎重さと創造性のバランス

Claudeは、憲法原則に則り「有害・差別的・過激な内容」を自制します。そのため、フィクションや創作のスタイルがより構造的・中立的に出やすく、ChatGPTのような自由奔放な表現にはやや劣るとの評価もあります 。

ただし、Sonnet 4以降は表現の柔軟性が向上し、過度に拒否しないよう配慮された設計になっているため、感情や創造性を保ちつつも安全性を損なわない調整が進行中です 。

5.3 カスタマイズ性と操作性の制約

AnthropicのClaudeは、従来型のファインチューニングには非対応です。代わりに「Constitutional AI(憲法AI)」を用いてプロンプトや事前設定(モデル選択:Haiku/Sonnet/Opus)での制御による運用が基本となります。

このため、OpenAIのCustom GPTのように、企業が独自モデルを細かく調整する用途には制限があります。しかし、プロンプトエンジニアリングや上位API統合(GitHub連携など)で柔軟な運用は可能です。

5.4 言語によるバイアスや差異

arXivの「 Beyond No: Quantifying AI Over-Refusal and Emotional Attachment Boundaries」によると、英語版Claudeは感情境界制御において43%以上の拒否率ながら、非英語では1%以下と拒否傾向に大きな差があることが確認されています。

つまり、日本語利用時には「過剰な控えめ」「重要なニュアンスの解釈誤り」などが生じる可能性があり、二次レビューやプロンプトへの文脈補足が推奨されます。

5.5 ファイルや画像処理の限界

Claudeでは、PDF、DOCX、CSV、TXT、HTMLなど多様なファイル形式のアップロードに対応しています。ただし、1ファイルあたり最大30MB、1回のチャットで最大20ファイルまでという制限があります。Project(ナレッジベース)機能ではファイル数に制限はありませんが、全体がコンテキストウィンドウに収まる必要があります。

また、PDFファイルについては、100ページ未満であれば画像や表を含む視覚要素も解析可能ですが、100ページを超えるとテキストのみが処理されます。他のファイル形式に含まれる画像も基本的には認識されません。

画像ファイルについては、JPEG、PNG、GIF、WEBPなどに対応しており、最大30MBかつ8000×8000ピクセルまでアップロードできます。ただし、正確な処理を行うには1000×1000ピクセル以上の解像度が推奨されます。

6. まとめ

Claudeは、Anthropicが開発した大規模言語モデルであり、憲法AI(Constitutional AI)という独自の手法を採用し、安全性と一貫性を重視した設計が特徴です。長文処理、ファイル解析、セキュリティ対応、外部ツールとの統合など、特定の業務用途に対応する機能が整っており、企業や研究機関での活用が進んでいます。

一方で、画像生成の非対応、カスタマイズ性の制限、日本語対応のばらつきなど、利用上の留意点も存在します。Claudeを導入する際は、他のモデルとの機能比較や、業務要件との整合性を踏まえた判断が求められます。導入可否は、使用目的、必要な機能、運用体制に応じて検討することが適切です。

よくある質問

憲法AI(Constitutional AI)は、Anthropicが独自に提案したアプローチで、AIが人間の価値観や倫理原則に沿って自律的に振る舞うことを目指しています。これに対して、従来主流だったRLHF(Reinforcement Learning from Human Feedback)は、人間の手動評価によって「望ましい」応答を選び、それを報酬信号としてモデルを学習させる方法です。

大きな違いは、RLHFでは学習過程がブラックボックス化しやすく、倫理原則が曖昧になりがちなのに対し、憲法AIでは「透明な原則(例:人権、尊重、公正)」を事前に定義し、その原則に則ってAIが自分の出力を自己評価・修正します。このプロセスにより、出力の一貫性や説明可能性が大幅に向上し、企業や公共分野での信頼性の高いAI運用が可能になります。

Claudeが持つ200,000トークンという巨大なコンテキストウィンドウは、他の主要モデルと比較して圧倒的に長く、約400ページ分のテキストを一度に処理できます。これは、単なるチャットや短文応答を超え、ビジネスや研究の現場で「1つの大規模文書を丸ごと読ませて、深く分析させる」ことを可能にします。

例えば、法務部門では複数の契約書を読み込ませて条文の差異や矛盾を抽出し、リスク箇所を特定することができます。エンジニアリングの分野では、大規模コードベースや技術仕様書を読み取って、関数間の依存関係を可視化したり、潜在的なバグを検出したりもできます。人間が数日かけて行う作業を、Claudeが数分でサポートすることで、生産性が大きく向上します。

Claudeは、Anthropicの「憲法AI」アプローチによって設計されており、実際のベンチマークでもその安全性が証明されています。たとえば、Claude 3.5では、有害な出力(暴力的、差別的、誤情報など)を返す確率がわずか0.1%未満に抑えられていると公表されています。これは業界でも非常に低い水準であり、商用利用において大きな安心材料となります。

また、Claudeは攻撃的なプロンプトやセンシティブな質問に対して、「この内容には応答できません」と明確に拒否する傾向があり、その判断は事前に定義された「憲法」に基づいて行われます。人間のフィルタを通さず、AIが自律的に安全性を判断できるという点で、リスク管理が強化されています。これは特に、教育や医療、金融といった公共性・倫理性が重視される業種で非常に有用です。

Claudeは画像解析やドキュメント解析にも対応しており、PDFファイルの読み取りや図表の要約、画像内の文字の認識(OCR)などもこなします。たとえば、スキャンされた契約書から必要な情報を抜き出したり、決算資料のグラフを自動的に解釈してトレンド分析を行ったりすることが可能です。

ただし、いくつかの制限があります。1つはファイルサイズで、画像を含むアップロードは1ファイル30MBまで、最大5ファイルまでに制限されており、大規模な3Dファイルや高解像度データには不向きです。また、画像生成はサポートしていないため、ChatGPTやGeminiのようにビジュアルを「作る」ことはできません。あくまで、既存の情報を「読み解く」ことに特化した設計となっています。

Claudeはファインチューニング(再学習)やモデルの再訓練を提供していないため、ChatGPTのCustom GPTのように完全に業務仕様に最適化するのは難しいです。しかし、その代わりに「プロンプト設計」と「外部ツールとの統合」で高いカスタマイズ性を実現できます。

具体的には、SlackやGitHubといった業務ツールと連携し、特定のフォーマットや処理ルールをプロンプト内に明記することで、タスク自動化や一貫したレポート出力が可能になります。また、Haiku(軽量・高速)、Sonnet(バランス型)、Opus(高性能)といったモデルを使い分けることで、コストと精度のバランスを調整することも可能です。

EN

EN JP

JP KR

KR