メタ学習とは?学習方法を学ぶ人工知能の新たな枠組み

人工知能(AI)の発展において、学習アルゴリズムの改良は常に中心的な課題となってきました。その中で注目されているのが「メタ学習(meta learning)」です。メタ学習は「学習のための学習」とも呼ばれ、単一のタスクを習得するのではなく、「どのように学ぶか」という学習プロセスそのものを習得する概念を指します。この考え方は、人間が新しい課題に対して過去の経験を活かして効率的に学ぶ仕組みに着想を得ています。

従来の機械学習では、各タスクごとにモデルを一から訓練する必要がありましたが、メタ学習では学習方法を抽象化することで、少量のデータでも高い適応力を示すことが可能です。これにより、少ない情報から迅速に新しい環境や課題に対応できるAIの開発が実現されます。また、タスク間での知識転移や汎用性の向上も期待され、応用範囲は画像認識、自然言語処理、ロボティクスなど幅広く広がっています。

本記事では、メタ学習の定義と背景を整理した上で、主要アルゴリズム、応用分野、類似概念との違いについて専門的に解説します。メタ学習の本質を理解することは、AIモデルの柔軟性・適応性を高める上で不可欠であり、将来の学習システムの設計における基盤的知識となります。

1. メタ学習とは?

1.1 定義

メタ学習とは、複数のタスクを通じて学習アルゴリズム自体を最適化する手法を指します。すなわち、単なるモデルの学習ではなく、学習プロセス全体をメタレベルで制御するアプローチです。この手法の目的は、未知のタスクに対して迅速かつ効果的に適応できるモデルを構築することにあります。

1.2 メタレベルの構造

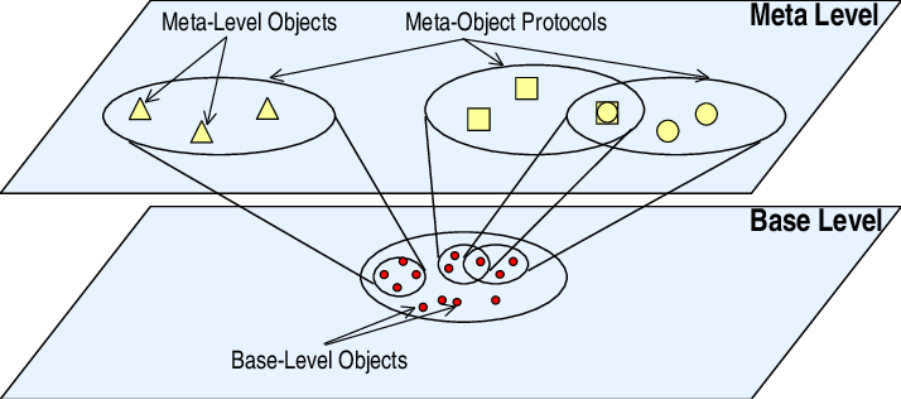

メタ学習は通常、「メタレベル(Meta-level)」と「ベースレベル(Base-level)」という二層構造で構成されます。ベースレベルでは個々のタスクに対する学習が行われ、メタレベルではそれら複数の学習結果から共通の学習戦略を抽出します。こうした構造により、モデルは新しい課題に対しても迅速に最適化可能な能力を獲得します。

2. メタ学習と関連概念の違い

AI分野では、学習の効率化や汎化性能の向上を目指してさまざまな学習手法が研究されています。その中でも「メタ学習」「転移学習」「継続学習」は、既存の知識を活かして新たな課題に対応するという点で共通しています。しかし、それぞれが焦点を当てる学習の仕組みや目的は異なります。

以下の表では、それらの違いを多角的に比較します。

観点 | メタ学習(Meta Learning) | 転移学習(Transfer Learning) | 継続学習(Continual Learning) |

| 定義 | 学習方法そのものを学ぶ | 既存タスクの知識を新タスクに転用 | 既存知識を保持しながら新タスクを学習 |

| 主目的 | 新タスクへの迅速な適応 | 学習コスト削減 | 長期的な知識統合 |

| データ利用 | 複数タスクのメタデータを利用 | ソースとターゲットデータを利用 | 時系列的にデータを利用 |

| 応用分野 | Few-shot、強化学習、ロボティクスなど | 画像認識、自然言語処理など | AIエージェント、自動制御など |

| 学習戦略 | 「学習器(learner)」と「メタ学習器(meta-learner)」の2層構造 | 事前学習済みモデルの微調整(fine-tuning) | 連続タスク間で重みを調整し知識を保持 |

| モデル更新方法 | 新タスクに応じて学習アルゴリズム自体を更新 | 既存モデルのパラメータを再利用・最適化 | 古い知識を忘れないように徐々に更新 |

| 汎化能力 | 高い(未知のタスクでも適応可能) | 中程度(関連性のあるタスクに強い) | 高い(長期間での適応性重視) |

| 主な課題 | 計算コスト、タスク設計の複雑さ | ドメイン不一致、過学習リスク | 忘却(catastrophic forgetting)問題 |

この比較から、メタ学習は他の学習手法に比べて「学び方を学ぶ」という抽象的かつ柔軟な能力を重視していることが分かります。

転移学習が「知識の再利用」、継続学習が「知識の維持」に焦点を当てるのに対し、メタ学習はそれらを包括する「学習の最適化そのもの」を目指すアプローチです。

3. メタ学習の主な手法

メタ学習(Meta Learning)は、モデルが「学習の仕方」を学ぶ仕組みを構築する技術であり、その実現方法には複数のアプローチがあります。以下では、代表的な3つの基本手法と、実践的応用例を含む発展的アプローチについて解説します。

3.1 モデルベースアプローチ

モデルベースのメタ学習では、学習モデル自体に「記憶」や「適応能力」を持たせる構造を設計します。代表的な手法には、Memory-Augmented Neural Network(MANN)や Neural Turing Machine(NTM)が挙げられます。これらは、過去のタスクで得た知識を動的に参照し、新たなタスクに即座に適応することを可能にします。

この手法の強みは、短期的な学習や未知環境への適応に優れている点です。例えば、入力パターンの変化が頻繁に起こる制御タスクやリアルタイム応答が必要なアプリケーションで高い効果を発揮します。

一方で、モデル構造が複雑になりやすく、学習コストが高いという課題も存在します。そのため、軽量化や効率的なメモリ更新機構の研究が進められています。

3.2 最適化ベースアプローチ

最適化ベースのメタ学習は、「学習アルゴリズムそのものを学習」する手法です。代表的な例が MAML(Model-Agnostic Meta-Learning)であり、初期パラメータを最適化して少数の更新で新タスクへ適応可能にします。

MAMLはモデルに依存せず、CNN・RNNなどさまざまな構造で利用できる汎用性の高さが特長です。画像認識や言語処理といった異分野のタスクにも横断的に対応できるため、企業のAI導入現場でも採用が進んでいます。

このアプローチは、複数のタスク間で共有できる「共通表現」を抽出し、学習効率を飛躍的に向上させます。少量データ環境での迅速なモデル適応を実現できる点が、他手法にはない強みです。

3.3 メトリックベースアプローチ

メトリックベースアプローチでは、タスク間の距離や類似度を定量化し、近いタスクの知識を再利用します。Prototypical Networks や Matching Networks が代表的で、特徴空間におけるデータ間距離を最小化することで分類性能を高めます。

この手法は、特にFew-shot Learning(少量データ学習)と相性が良く、教師データが限られた環境でも高い精度を維持できます。顔認識や製品検査など、データ収集が難しい現場で実用化が進んでいます。

また、学習済みタスクからの転移が容易であるため、新規タスクの初期学習を効率化できる点も大きな利点です。

3.4 MAMLの概要と特長

MAML(Model-Agnostic Meta-Learning)は、最適化ベースアプローチの中核をなす手法であり、タスク非依存型のメタ学習として知られています。特定のモデル構造に制限されないため、画像分類から自然言語処理まで幅広い分野で応用が可能です。

MAMLの特徴は、少量のタスクデータから迅速にパラメータを更新できる点にあります。これにより、従来数千サンプルを必要とした学習を、数十サンプルで達成できるケースもあります。

実務では、プロトタイピングや製造現場の異常検知などで導入が進んでおり、柔軟かつ効率的なAI運用を支えています。

3.5 Neural Processによる関数学習アプローチ

Neural Process(NP)は、確率過程を基盤としたメタ学習手法で、データ背後の「関数的構造」を学習します。少量のサンプルから関数全体を近似できるため、未知データに対しても高い予測性能を発揮します。

このモデルは、MAMLに比べて計算コストが軽く、スケーラビリティに優れています。特に、需要予測や品質管理など、連続的なデータ変動を扱う業務で有効です。

製造業では、ライン異常の検知や製品品質の予測などに応用され、限られたデータからでも高精度な判断を支援します。

3.6 Siamese Neural Networksによる特徴学習

Siamese Neural Networksは、入力ペア間の類似度を学習するネットワーク構造を採用しており、メトリックベースアプローチの代表的な実装です。特徴空間上で距離を最小化することで、サンプル数が少なくても高精度な識別を可能にします。

この仕組みは、顔認証、署名検証、製品検査などの分野で広く利用されています。たとえば、製品検査では「正常サンプル」が極めて少ない状況でも、既存知識を活用して欠陥の有無を高精度に判定できます。

さらに、Siamese構造は軽量で訓練が高速なため、リアルタイム処理にも適しており、モバイルデバイスへの実装も進んでいます。

メタ学習にはモデル構造・最適化手法・距離学習など多様なアプローチが存在します。それぞれが異なる目的と特性を持ちながらも、「少量データで高適応」を共通目標として発展しています。

これら手法を組み合わせたハイブリッド型メタ学習や、リアルタイム適応型AIの実用化が期待されています。メタ学習は、AIの自律的進化を支える次世代の中核技術といえます。

4. メタ学習の応用領域

4.1 Few-shot Learning(少量データ学習)

Few-shot Learning は、メタ学習の最も代表的な応用分野の一つです。従来の機械学習モデルは、大量の学習データを必要としますが、Few-shot Learning ではわずか数サンプルのデータからも高精度な予測が可能になります。これは、モデルが「学習方法を学ぶ」ことで、未知のタスクに迅速に適応できるよう設計されているためです。

この技術は、医療画像診断、自然言語処理、バイオインフォマティクスなど、データ収集が困難または高コストな領域で特に有効です。少数のラベル付きデータしか得られない場合でも、既存の知識を再利用して高い汎化性能を発揮します。

さらに、Few-shot Learning の発展により、AIモデルは人間のように「経験から学ぶ」能力を獲得しつつあります。これにより、モデルのトレーニング効率が飛躍的に向上し、学習コストを大幅に削減することが可能になっています。

4.2 継続学習(Continual Learning)

継続学習は、AIモデルが時間の経過とともに新しい情報を学び続ける仕組みを指します。従来のモデルは一度学習を終えると再訓練が必要でしたが、メタ学習を取り入れることで、既存知識を保持したまま新たなタスクに適応できるようになります。

この手法の最大の利点は、「忘却問題(catastrophic forgetting)」の軽減にあります。新しいタスクを学んでも、過去の知識を失うことなく、モデル全体の知識体系を発展させることが可能です。

継続学習は、ロボティクスや自動運転システムなど、環境変化への対応が求められる分野で特に重要です。現実世界の複雑な条件下でも、メタ学習による適応能力がモデルの長期的な性能維持を支えます。

4.3 強化学習(Reinforcement Learning)への応用

メタ学習は、強化学習分野においても重要な役割を果たします。エージェントが環境から報酬を得るプロセスを通じて、学習速度を向上させ、より効率的な探索を実現できます。特に環境設定や報酬構造が頻繁に変化するケースでは、メタ学習が大きな効果を発揮します。

このアプローチにより、エージェントは過去のタスクで得た知識を転移し、新しい状況にも短時間で適応可能になります。これにより、試行錯誤にかかる計算コストや時間が大幅に削減されます。

具体的な応用例としては、ロボット制御、ゲームAI、自動運転などが挙げられます。環境の動的変化に対応しながら最適な行動戦略を見出す力は、メタ学習によってさらに高い水準に引き上げられています。

4.4 自然言語処理(Natural Language Processing)への応用

メタ学習は自然言語処理(NLP)の分野でも大きな成果を上げています。特に、文脈理解や意味推論といった高次のタスクでは、メタ学習による知識転移が有効に機能します。従来のモデルが特定ドメインに特化してしまうのに対し、メタ学習を導入したモデルは異なる文体や専門領域にも柔軟に対応できます。

この応用は、チャットボット、翻訳システム、質問応答AIなど、ユーザーとの自然な対話が求められる領域で顕著です。限られた教師データでも、他分野で得た文脈知識を再利用することで、高い自然言語理解力を維持します。

さらに、メタ学習は「少量学習+適応学習」の枠組みを強化し、リアルタイムで文脈に応じたチューニングを実現します。その結果、NLPモデルはより人間に近い柔軟な応答を生成できるようになっています。

4.5 ロボティクスへの応用

ロボティクス分野におけるメタ学習の価値は、環境変化への迅速な適応能力にあります。ロボットは多様な状況下で動作する必要があり、すべての環境を事前学習することは困難です。メタ学習を導入することで、ロボットは新しいタスクや未知の環境にも短時間で適応できます。

たとえば、異なる地形での歩行制御や、新しい物体を扱うための把持操作など、従来なら再訓練が必要だった動作を、少量の試行で最適化することが可能です。これにより、ロボットの自律性と応用範囲が大幅に拡大します。

さらに、メタ学習は強化学習と組み合わせることで、ロボットの自己改善サイクルを加速させます。経験を蓄積しながらタスク遂行精度を高める能力は、次世代の知能ロボット開発における中核技術となっています。

5. メタ学習の課題と今後の展望

メタ学習は理論的にも実践的にも高い可能性を秘めていますが、いくつかの課題も存在します。まず、メタトレーニングに要する計算コストが大きく、タスク数が多い場合にスケーラビリティが問題となります。また、タスクの多様性が不十分な場合、一般化能力が十分に発揮されないこともあります。

今後は、より効率的なメタ最適化アルゴリズムや、タスク分布のモデリング技術の発展が求められます。さらに、メタ学習の考え方は、人間の知能の理解や自律的学習システムの設計にも応用可能であり、AI研究全体の基盤を拡張する可能性を持ちます。

おわりに

メタ学習(Meta Learning)は、AIが単なるデータ処理を超えて「学習の方法そのもの」を獲得することを目指す革新的なアプローチです。これは、人間が過去の経験を応用して新しい課題に迅速に適応する仕組みを模倣したものであり、AIに「学び方を学ばせる」ことを可能にします。

従来の機械学習では、各タスクごとにモデルを一から訓練する必要がありましたが、メタ学習では一度の学習プロセスを通じて、異なる課題にも柔軟に対応できる能力を育成します。その結果、少量のデータしか得られない状況でも、高い適応力と汎化性能を発揮できる点が大きな特長です。

さらに、メタ学習の枠組みは Few-shot Learning や強化学習、自己教師あり学習など他の学習手法との連携によって拡張されています。こうした統合的な進化により、メタ学習は次世代の汎用人工知能(AGI)に向けた基盤技術として、今後ますます重要な役割を担うことが期待されています。

EN

EN JP

JP KR

KR